跑酷|解密:波士顿动力如何用算法构建Atlas机器人的感官世界

文章插图

编译 | 王琪瑞

校对 | 青暮

波士顿动力一周前发布了一个长达90秒的视频。在视频中,Atlas完美地跑完了复杂的障碍赛。

于是有很多网友好奇是什么黑科技让机器人可以如此智慧。

机器人该怎么样才能像运动员一样奔跑、翻转、跳跃?创造这些高能演示的是一个有趣的挑战,但波士顿的技术目标不仅仅是创造一场华丽的表演。在Atlas项目中,他们以跑酷为实验主题,通过动态运动,感知和控制之间的联系,来研究相关的问题。这些问题的解决有助于机器人更加顺畅地运行。

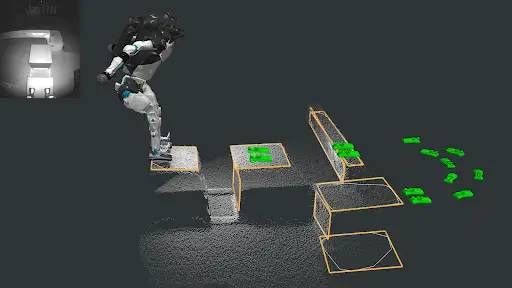

机器人感知算法会被用到相机和激光雷达等传感器的数据转换对策和规划物理行动中。虽然Atlas使用IMU、关节位置和力传感器来控制其身体并感受地面获得平衡,但Atlas还需要感知算法来识别障碍物,如图1中看到的木箱和窄桥

文章插图

Atlas使用深度相机以每秒15帧的速度生成环境点云。点云是距离测量数据的集合。Atlas的感知软件使用多平面分割的算法从点云中提取表面。接着算法输出的数据被输入地图系统,最后系统帮助Atlas用相机看到不同物体建立模型。

文章插图

为了扩展跑酷课程,机器人被导入一张高级地图,其中包括命令它去哪里,以及路上应该做什么动作。这张高级地图与实际课程不完全一致,它是对障碍物位置和一些主要动作的简要描述。所以Atlas会使用这些简要的信息来导航,同时使用实时感知数据来填充细节。例如,Atlas寻找一个可以跳跃的盒子,如果盒子移动到侧面0.5米,Atlas会在那里找到并调整姿势。如果盒子移动得太远,系统找不到它就会停下来。

文章插图

图3:展示机器人对跑酷课程中伙伴的感知的动画。

这是一个3D可视化动图,展示了机器人在跑酷障碍跑道上看到的内容和机器人通过内容反馈的计划。主动跟踪的物体被绘制成绿色,当物体的距离超过感知范围时,图标就会从绿色变成紫色。跟踪系统也会不断跟进物体的姿态传给导航系统,导航系统会通过地图上的信息设计好对应物体的绿色脚印。

你在跑酷程序中看到 Atlas 执行的每个动作都来自“轨迹优化离线设计”创建的模板。这些模板库,允许科研人员往库中添加新的轨迹,添加新的功能。

轨迹优化离线设计,可以让工程师交互探索机器人能力的极限,并减少机器人的计算量。例如,机器人如何收起四肢做后空翻,这些成就对项目的推进有莫大的帮助。因为这样可以帮助机器人做到最合理的驱动。科研人员可以利用离线优化捕捉重要的发力点,并使用控制器在线调整它们的动作。

- 原神常夜灵庙怎么破解?原神常夜灵庙解密攻略

- 数字平原解密虚幻引擎制作</stron...|数字平原解密虚幻引擎制作CG场景

- 波士顿动力玩转CES,Spot机器狗走进元宇宙!

- NOLOSonic|烧脑解密类游戏「逃出房间1」、「立体拼图(6DoF版)」正在NOLO Sonic商城热卖中!

- 2020年1月11日通过国家验收|动科普|巡天探宇解密星空 中国天眼“成绩单”来了

- 亚马逊|亚马逊运营:怎样布局listing流量入口?bestseller解密

- iqoo|从发布会邀请函解密iQOO9系列:搭载骁龙8,首发GN5

- 【专利解密】消除裂缝求“生存” 中微半导体发明基片上生长缓冲层方案

- 华为|机器人时代已经来临?看看波士顿动力的机器人就知道了

- 从发布会邀请函解密iQOO9系列:搭载骁龙8,首发GN5