人工智能|焦李成院士:进化优化与深度学习的思考( 三 )

神经网络的发展有很长的历史,上述图片展示了一些卓越贡献者。例如最早生物神经元的提出者、MP神经元模型的提出者、感知机的提出者、连续神经元的提出者以及到后来明斯基提出感知器只能解决线性可分问题而不能解决非线性异或问题。

其他学者在神经网络领域的贡献更加出色和难能可贵,例如Grossberg夫妇奋斗一生提出了自适应共振机理论和三个ART系统。

在中国层面,提出发育神经元模型的吴文俊先生,提出视觉通路中三色传导学说的张香桐先生,模式识别的创始人傅京荪以及提出了忆阻器、Chua电路、细胞神经网络等理论的蔡少棠先生为神经网络的发展做出了巨大贡献。

值得一提的是,郭爱克、陈霖、蒲慕明等学者在生物领域的工作,为建立神经网络提供了良好的基础。

时刻不能忘记前辈的努力,当代华人学者也在接力,他们卓越的学术工作使得中国在国际上更有影响力。

另外,在2021年,深度卷积网络发明者日本学者福岛邦彦获鲍尔奖,表彰他通过发明第一个深度卷积神经网络「 Neocognitron」将神经科学原理应用于工程的开创性研究,这是对人工智能发展的关键贡献。LeCun也曾评价:福岛邦彦教授1980年的卷积网络工作给了他很大的启发,促使了他1989,1998年分别提出CCN和LeNet。

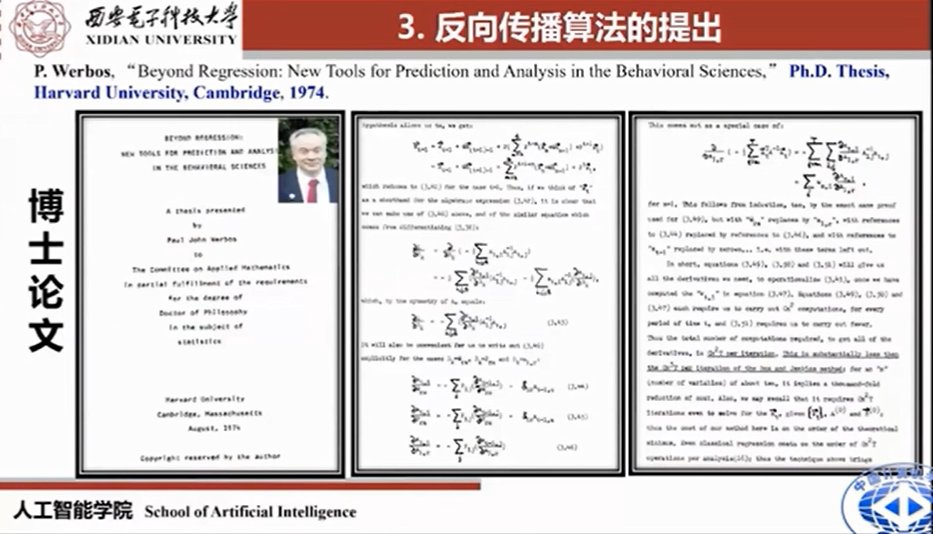

人工智能的发展和深度学习的兴起分不开,从1943年、1944年、1949年到今天,已经经历了几起几落。值得一提的是,BP算法的出现让神经网络可以学习多层网络,从某种意义上回答了明斯基“单层感知器不能解决非线性可分”的问题。

文章插图

BP算法出现自1974年,P.Werbos在其哈佛大学博士论文中首次给出详细的数学推导。之后众多学者在其基础上进行改进才有了今天神经网络的发展。2021年Francis Crick最新工作指出:大脑实际上不太可能使用反向传播,也就是说BP复制或传递突触权重的信息进行更新,但是在生物网络中,神经元只能接收到其他神经元的输出信息,而不能接收到突触权重或内部过程。这一发现也指出,更具生物学意义的学习机制,或许可以替代反向传播机制,例如反馈比对、预测性编码、锥体神经元、注意力机制等等。

因此,神经网络不应该只是如今意义上的权重调参,更重要的是其结构要具有变化性、可塑性、学习性和动态性,目前这些特性是现在深度网络所没有重视的。

同样,在类脑感知的过程中,奖惩机制、学习机制、信息表征机制、再生长和发育机制等,对于信息的重建、记忆编码和处理具有重要的作用。目前这些特性在深度神经网络中也没有得到重视。

人工智能中的“特征工程”、“特征搜索”、“表征学习”的说法,应该换成“大数据驱动下的表征学习”、“大数据和知识先验驱动下的表征学习”,这样显然更有意义。

- 园区|满满的“科里科气”!安徽首条人工智能商业街将在合肥亮相

- 苏宁|年货节家装发货量增1.3倍苏宁易购物流2022年继续聚焦核心阵地

- 焦李成院士:进化优化与深度学习的思考

- 合肥|满满的“科里科气”!安徽首条人工智能商业街将在合肥亮相

- 电影|三部人工智能题材科幻片,都是精品,你可能想不到还有一部国产片

- 关机|人工智能拓展机器人的能力和功能,推动了机器对人的脑力劳动的替代

- 高通骁龙|骁龙8变焦王即将登场:最高10倍光学变焦,但比荣耀Magic V还要贵

- 机器人|人工智能越来越先进,未来这些职业或被取代

- 汽车产业|央视《焦点访谈》实地探访萝卜快跑:自动驾驶成为中国经济发展新动能

- 电子商务|李成东电商年度演讲圆满举办,专业主义,你唯一的生存之道